4 de mayo de 2026

5 min de lectura

Estrategia Digital en Escenarios Reales: Cómo la Arquitectura de Software Define la Capacidad Operativa

El valor estratégico de una arquitectura digital no reside en su desempeño bajo condiciones ideales de laboratorio, sino en su capacidad para sostener la productividad en los puntos más exigentes de la operación diaria. Cuando un profesional, tras una breve pausa de cinco minutos, se encuentra con una pantalla de carga que supera el minuto en una zona de conectividad limitada, lo que estamos observando es una degradación de la capacidad operativa de la organización. A menudo, la respuesta instintiva es atribuir estas demoras a factores externos como la infraestructura de red. Sin embargo, un análisis profundo revela que el origen puede residir en matices sutiles del modelo de despliegue; detalles que, si no se consideran con rigor técnico, transforman una actualización de rutina en un obstáculo para la continuidad del negocio.

Contexto: La Invisibilidad del Impacto Organizacional

En sectores donde la disponibilidad de la información es crítica, como la salud digital, la operatividad bajo condiciones de red heterogéneas es un requisito de diseño fundamental. El caso de estudio de este cliente de Nursoft se centra en una plataforma que soporta a aproximadamente 800 usuarios mensuales, quienes operan frecuentemente en entornos de baja capacidad, ya sea por su ubicación geográfica o por las limitaciones de la infraestructura institucional [1]. Este escenario es representativo de cualquier sistema con usuarios distribuidos y despliegues frecuentes, como ERPs, CRMs o plataformas logísticas, donde cada segundo de latencia se traduce en un costo transaccional.

El desafío identificado involucraba un patrón de uso donde las transiciones entre módulos —de la agenda a la estación de diagnóstico— forzaban descargas de datos redundantes. Para una organización con ciclos de actualización semanales, esto significaba que su base de usuarios re-descargaba código que no había cambiado para ellos, generando una fuga silenciosa de tiempo y recursos. Lo más crítico es que este impacto solía ser invisible para el equipo de desarrollo, ya que el problema es prácticamente imperceptible en entornos con conectividad de alta velocidad.

El Problema: El Impacto de lo Invisible

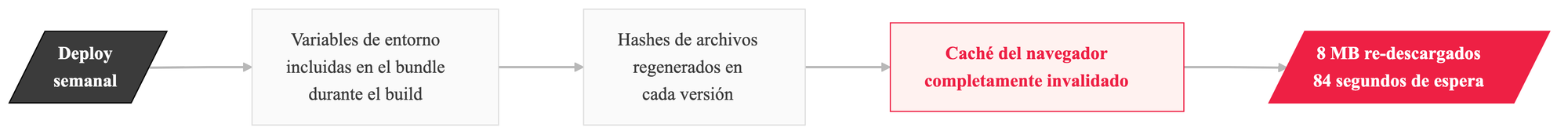

La identificación de la ineficiencia requirió observar más allá de los síntomas superficiales. Mientras que la percepción general apuntaba a una "red lenta", el diagnóstico técnico permitió detectar que la causa podía residir en un detalle casi imperceptible del proceso de construcción del software: las variables de ambiente estaban embebidas directamente en el paquete de código (el bundle) durante el build. En frameworks modernos como Vite o Webpack, esta práctica es el estándar por defecto, pero sus implicaciones en entornos de producción son profundas y a menudo ignoradas [2].

Este detalle técnico provoca que cada nuevo despliegue genere identificadores únicos (hashes) para los archivos, lo que obliga al navegador del usuario a descartar preventivamente todo el caché almacenado, aunque la lógica del negocio no haya variado [2]. Al reproducir estas condiciones mediante una simulación de red 3G, las métricas fueron contundentes: una segunda carga recurrente transfería 8MB de datos, resultando en esperas de 1.4 minutos. La red no causaba el problema; simplemente exponía una arquitectura de entrega que trataba componentes estables como si fueran volátiles, saturando el canal de comunicación sin una justificación técnica funcional.

La Solución: Ingeniería para la Continuidad

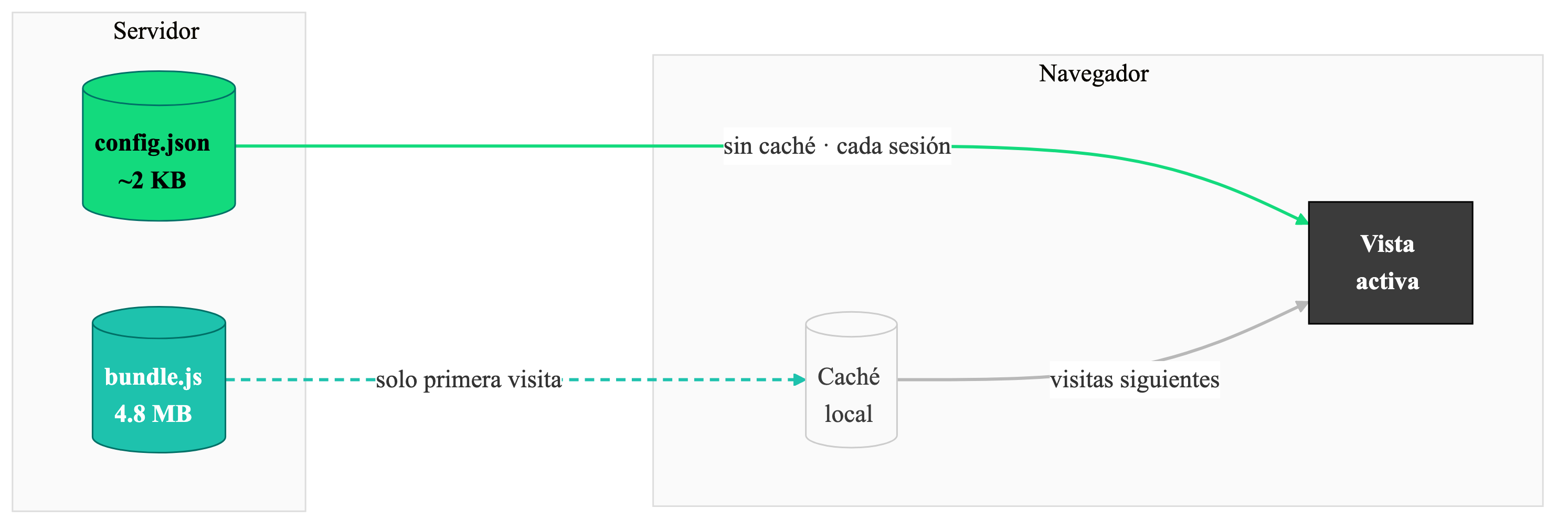

La resolución de este conflicto no requirió un aumento en el ancho de banda, sino una reingeniería del modelo de entrega para proteger la estabilidad de los recursos en el cliente. La estrategia se centró en desacoplar la configuración operativa de la lógica de negocio. La primera medida consistió en separar la configuración en runtime, trasladando las variables de ambiente a un archivo externo de apenas 2KB. Al servirse sin políticas de caché, este archivo permite que los paquetes de código principales permanezcan inmutables y persistentes en el dispositivo del usuario, incluso tras múltiples actualizaciones del sistema [1].

De forma complementaria, se ejecutó una migración hacia Vite para implementar estrategias avanzadas de lazy loading y code splitting. Al refactorizar la estructura de los imports, se garantizó que la plataforma descargara únicamente los fragmentos de código estrictamente necesarios para la vista activa, reduciendo el peso del bundle inicial de 8MB a 4.8MB [3]. Esta intervención técnica asegura que, tras la primera visita, el usuario solo necesite validar un archivo mínimo, recuperando el resto de la plataforma desde su memoria local de forma casi instantánea.

Impacto: Recuperando Capacidad Operativa

Los resultados obtenidos bajo las mismas restricciones de conectividad demuestran cómo la atención a los detalles arquitectónicos puede transformar la viabilidad de un producto. La optimización de los recursos fue drástica: el tiempo de espera para una carga recurrente descendió de 1.4 minutos a solo 17 segundos, lo que representa una recuperación del 88% en la velocidad de acceso percibida por el profesional.

En términos de eficiencia de datos, el volumen transferido por sesión se redujo de 8MB a solo 2KB, una disminución del 99%. Este cambio eliminó el costo oculto asociado a cada despliegue semanal, donde anteriormente se forzaba la descarga masiva de código de forma redundante. Para la organización, esto no es solo una métrica de rendimiento; es la recuperación de miles de horas de uso efectivo para sus 800 usuarios activos, transformando un cuello de botella tecnológico en una ventaja de disponibilidad operativa. Una comparativa de rendimiento evidencia los resultados:

| Métrica | Antes | Después | Mejora |

|---|---|---|---|

| Tiempo de carga (2ª visita) | 84 s (1.4 min) | 17 s | −88% |

| Datos transferidos por sesión | 8 MB | 2 KB | −99% |

Conclusiones: El Valor de la Precisión Técnica

Este caso de estudio subraya que el rendimiento en producción es el resultado de decisiones de diseño que a menudo se consideran secundarias. El antipatrón de embeber configuración volátil en estructuras estables es una práctica común que permanece invisible en entornos ideales, pero que se vuelve crítica en la operación real [4].

La separación de lo volátil de lo estable debe considerarse una condición mínima de arquitectura para sistemas distribuidos en cualquier industria [4]. En última instancia, la mejora de 1.4 minutos a 17 segundos nos recuerda que los grandes problemas de eficiencia suelen resolverse examinando con rigor técnico aquellos procesos invisibles que ocurren en el milisegundo de la creación del software.

Referencias

[1] M. Hosseini, S. Darabi, P. Eugster, M. Choopani, A. Jahangir. *Rethinking Web Caching: An Optimization for the Latency-Constrained Internet*. Proceedings of the 23rd ACM Workshop on Hot Topics in Networks, 2024. https://doi.org/10.1145/3696348.3696873

[2] Q. Zheng, T. Yang, Y. Kan, X. Tan, J. Yang, X. Jiang. *On the Analysis of Cache Invalidation With LRU Replacement*. IEEE Transactions on Parallel and Distributed Systems, vol. 33, pp. 654–666, 2022. https://doi.org/10.1109/tpds.2021.3098459

[3] T. F. Zanestri, I. Sardi, K. A. Laksitowening. *React-based Web Application Performance Optimization Using Code Splitting and Lazy Loading*. 2025 International Conference on Computing and Applied Informatics (ICCAI), pp. 1–7, 2025. https://doi.org/10.1109/iccai65301.2025.11279539

[4] M. Shahin, M. A. Babar, L. Zhu. *Continuous Integration, Delivery and Deployment: A Systematic Review on Approaches, Tools, Challenges and Practices*. IEEE Access, vol. 5, pp. 3909–3943, 2017. https://doi.org/10.1109/access.2017.2685629

Diseñado y publicado en 2026 por Nursoft ®.

Todos los derechos reservados.

Oficina Santiago

santiago@nursoft.cl

+562 2 604 8383

La Concepción 141, Oficina 907

Providencia — 7500010

Santiago, Chile

Sobre los Autores

- Gustavo Varas, Consultor de Nursoft. Ing. Civil en Ciencias de la Computación de la Universidad de Chile.